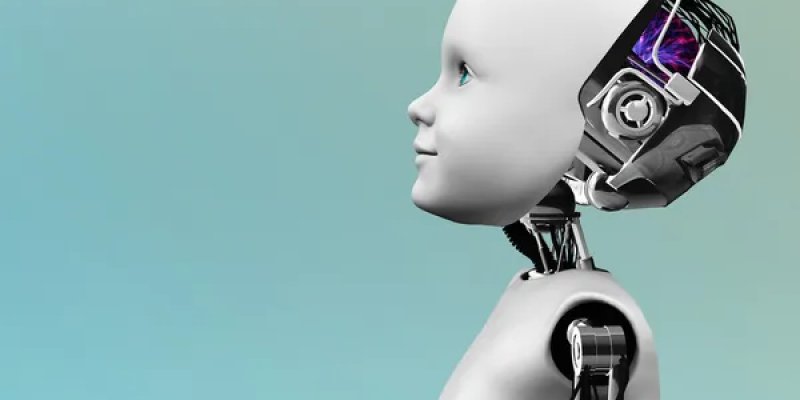

“AI itu kayak anak kecil nip, dia akan menyerap apa yang dia pelajari”

Itu perkataan kawan saya yang bekerja sebagai data scientist di startup kenamaan. Di sana kerjanya sering berkaitan dengan membuat machine-learning algorithm untuk membantu sistem rekomendasi aplikasi kirim makanannya. Saya sendiri pernah membantu mengkurasi data yang akan digunakan oleh algorithm tersebut. Lumayan banyak data awalannya, satu algorithm untuk menentukan pembagian makanan berdasarkan profil rasa saja butuh ribuan data makanan dari ribuan restoran dan warung.

Sejauh ini AI sering digunakan untuk membantu “mengotomasi” (ini kata favorit kawan saya yang barusan juga) tugas yang berulang. Seperti tugas merekomendasikan sebuah makanan berdasarkan pola pemesanan kita, video atau film apa yang akan kita sukai berdasarkan apa yang kita sudah pernah tonton, bahkan siapa orang yang sekiranya cocok menjadi pendamping hidup berdasarkan ketertarikan dua orang tersebut (no seriously, Tinder sudah menggunakan algorithm seperti itu sejak tahun 2015). Tugas tersebut cukup berulang dan sudah bisa dibantu oleh machine-learning algorithm.

Prinsip kerja machine-learning sebenarnya cukup sederhana. Terdapat sebuah algorithm yang membaca sekumpulan data set. Ia pun kemudian mencari korelasi-korelasi dari data set tersebut lalu menghasilkan sebuah keluaran yang akan mengikuti hukum-hukum korelasi yang ia temukan. Memahami secara detil hukum korelasi yang digunakan bisa membutuhkan 12 SKS sendiri, jadi itu di luar bahasan tulisan kecil ini.

Aplikasi dari machine-learning ini sangat luas. Jika kamu melatih sebuah machine-learning untuk mempelajari tren film populer, ia akan bisa mengeluarkan prediksi film seperti apa yang akan populer di tahun depan. Jika kamu melatih machine-learning untuk belajar bahasa, ia akan bisa mensimulasikan sebuah percakapan berdasarkan data percakapan milyaran manusia di seluruh dunia (ini yang tim ChatGPT lakukan). Jika kamu melatih machine-learning untuk mempelajari lukisan dan ilustrasi, ia akan bisa menghasilkan ilustrasi-ilustrasi dari apa yang ia pelajari.

Sekarang mari kita melihat sebuah studi kasus. Katakan Jono merupakan seorang gubernur dan Jono ingin membuat masyarakat semakin aman dan tentram. Jono pun berpikir, “Selama ini kan masalah yang terjadi adalah kejahatan yang penjahatnya tidak tertangkap. Bagaimana kalau aku bisa memprediksi di mana akan terjadi kejahatan jadi polisi bisa langsung dengan cepat dikirim ke daerah tersebut?” Jono pun mengontak tim programmer untuk membuat program yang dinamakan predictive policing. Program tersebut kemudian diluncurkan dan tingkat kejadian kejahatan pun turun. Jono berhasil

Namun, Jono belum berhasil. Dua tahun kemudian Jono dihadapkan dengan demo. Demo tersebut menuntut keadilan dalam mengurus kasus kekerasan polisi yang semakin kuat di daerah-daerah tertentu. Daerah yang mengalami kekerasan polisi pun semakin turun standar ekonomi hidupnya dan masalah-masalah sosial lain pun mulai muncul. Mengapa itu terjadi?

Skenario tadi bukan skenario khayalan. Sudah ada banyak jurnal yang membahas bahwa predictive policing hanya akan membawa kekerasan polisi kepada masyarakat yang sudah sangat terdampak secara sosioekonomi. Predictive policing yang diterapkan di Amerika Serikat menguatkan ketidakadilan ekonomi dan ras kepada Black American, karena data yang digunakan merupakan data penangkapan polisi Amerika Serikat yang bias. (misal: Orang kulit hitam jauh lebih mungkin ditangkap karena kejahatan narkoba dibanding kulit putih, padahal persenan penggunaan narkoba masing-masing segmen ras sama). Akhirnya, si algorithm tersebut lebih sering memprediksi terjadinya kejahatan di daerah yang padat kulit hitam. Dengan kebijakan polisi Amerika Serikat yang juga lebih berat menghukum kulit hitam dan kesulitan ekonomi yang selalu menghantui narapidana, hasil pemolisian berbasis algorithm ini tentunya akan sangat merugikan kulit hitam

Beberapa waktu lalu saya melihat thread di Twitter tentang seseorang yang mengajak ChatGPT mengobrol. Saya selidiki orang itu memiliki tendensi White Supremacy (menganggap bahwa orang kulit putih superior dibanding ras lain) yang lumayan kuat. Ia pun bisa memanipulasi dengan mudah ChatGPT agar dapat mengulang poin-poin propaganda white supremacy tersebut. Padahal orang tersebut tidak perlu mengeluarkan argumen-argumen sulit. Cukup menggunakan kalimat-kalimat trigger tertentu dan kemudian ChatGPT dapat mengeluarkan kalimat-kalimat yang menyetujui white supremacy. (Untuk ini, saya enggan memberi link sumber percakapan. Saya tidak sudi orang-orang seperti dia mendapatkan pamor)

Ini masalah dari algorithm yang kita punya sekarang. Data set yang kita punya tidak kita kurasi. Kita biarkan saja algorithm menelan semua data yang ada. Lebih parahnya, si pembuat algorithm tersebut memasukkan biasnya ke dalam algorithm dan lalu berlindung di balik kalimat “program ini objektif, tidak ada biasnya sama sekali”, walaupun pada kenyataannya dampak yang diciptakan program yang dia buat memiliki bias yang sangat kuat ke segmen tertentu

Teknologi bukan hal yang mutlak menyeramkan, maupun hal yang patut dihindari. Teknologi adalah hasil dari akumulasi ilmu manusia menyoal cara-cara manusia bisa survive dan bahkan thrive di bumi ini. Ia pun bisa digunakan untuk merawat bumi agar bumi ini juga bisa thriving bersama manusia. Yang patut diperhatikan adalah bagaimana cara kita memanfaatkan teknologi tersebut. Bahkan di niat sebaik-baiknya pun jika kita tidak menelaah bias-bias kita sendiri, bias itu akan ikut terbawa ke teknologi yang kita gunakan

Teknologi artificial intelligence adalah teknologi yang meniru cara manusia mengolah data. Mereka seperti anak kecil, yang akan menyerap apapun informasi yang diberikan oleh orang tuanya. Kita ummat manusia sebagai orang tua kolektif dari artificial intelligence ini harus bijak dalam memilah data mana yang dipelajari dan bagaimana membimbing artificial intelligence untuk belajar

Jadi, kepada siapa AI belajar?

Makasih kak Hanief. Tulisan ini jadi perspektif penting yang perlu betul-betul disadari. Kita cenderung menilai bahwa AI adalah perangkat yang independen - dan otonom. Perlu disadari, yang membuat AI adalah (kebanyakan) para kapitalis yang ingin mendapat keuntungan besar - dan ini sudah terbukti, dan bukan berpijak pada kemaslahatan seluruh umat manusia dan planet bumi yang saat ini sedang sakit keras... Rendahnya kesadaran, bias (tidak jernih berpikir) dan data yang ada di jagad internet ini menggambarkan peradaban yang sakit. Dan ini yang jadi basis data yang diolah oleh AI dan segala algoritmanya yang juga diwarnai kental oleh bias berpikir para codernya... Duh... 😔

yah begitulah kak.. syulit memang masa depan yang bakal kita wariskan ke generasi berikutnya